Por que o uso do reconhecimento facial nos estádios ainda é um problema?

Relatório aponta divergências no uso da tecnologia, que vai passar a ser obrigatória em boa parte dos estádios brasileiros em 2025

A partir de 2025, de acordo a Lei Geral do Esporte, estádios com capacidade maior que 20 mil pessoas deverão liberar o acesso dos torcedores através da biometria facial.

A Tecnologia de Reconhecimento Facial (TRF) é apontada pelas autoridades como uma forma de melhorar a segurança nos estádios, eliminar fraudes e a prática de cambistas, lidar com casos de violência e discriminação e melhorar a experiência dos torcedores.

Apesar disso, o uso da biometria ainda é controversa, gera dúvidas, e possui inúmeras preocupações relevantes.

O relatório o “Esporte, Dados e Direitos: O uso de reconhecimento facial nos estádios brasileiros”, publicado pelo O Panóptico, monitor de novas tecnologias na segurança pública do Brasil do Centro de Estudos de Segurança e Cidadania (CESeC), chama a atenção para essas questões.

Estatuto da Criança e do Adolescente

O uso da tecnologia de reconhecimento facial em crianças e adolescentes fere tanto o Estatuto da Criança e do Adolescente (ECA) quanto a diretriz estabelecida na Lei Geral do Esporte (artigo 158), segundo mostra o estudo. Isso porque a necessidade de controle biométrico é somente a partir dos 16 anos.

A prática também desrespeita o próprio Termo de Acordo entre a Confederação Brasileira de Futebol (CBF), o Ministério da Justiça e da Segurança Pública (MJSP) e a Lei Geral de Proteção de Dados (LGPD), que preveem a coleta e compartilhamento de dados após os 18 anos.

“Tem clube que está cadastrando criança de colo, que tem catracas pequenas para elas entrarem. Só que as crianças estão sob uma lei específica que, se para os adultos já não tem a referência à LGPD na Lei Geral do Esporte, quem dirá em relação ao ECA”, explicou Raquel Sousa, mestre em Ciências Sociais pela UERJ e uma das autoras do relatório.

É uma preocupação principalmente com a possibilidade de vazamento e utilização desses dados para, por exemplo, alimentar o banco de dados de inteligência artificial – destacou Raquel.

No futebol brasileiro, o Goiás, por exemplo, é um dos clubes que conta com catracas menores para o reconhecimento facial de crianças. De acordo com dados do próprio clube, dentre os 210 mil torcedores cadastrados, 30 mil têm entre dois e 14 anos, ou seja, 14,3% do total.

Com o avanço da utilização da Inteligência Artificial, é fundamental garantir o respeito à maioridade para a disponibilização dos dados. Em junho deste ano, a Universidade de Stanford, nos Estados Unidos, revelou que mais de 170 imagens e dados pessoais de crianças do Brasil foram coletados por um banco de dados sem o conhecimento ou consentimento dos responsáveis.

- - ↓ Continua após o recado ↓ - -

A Tecnologia de Reconhecimento Facial no Brasil

Atualmente, há no Brasil 22 projetos em estádios. Destes, 18 estão em uso, dois em teste e dois em estudo. São 14 estádios, dentre eles: Maracanã (RJ), Estádio Rei Pelé (AL), Estádio Hailé Pinheiro (GO), São Januário (RJ), Allianz Parque (SP), entre outros.

Em 2024 houve um aumento significativo de implementação da biometria facial. Só nos seis primeiros meses deste ano, foram iniciados 10 projetos, aproximadamente, quase o mesmo montante de todo o ano de 2023 (11 projetos).

Os projetos em cada estádio são, em sua maioria, gerenciados pelos respectivos clubes de futebol – ou por mais de um clube, como no Maracanã -, ou pelas Secretarias de Segurança Pública ou do Esporte de cada estado. Ou como na Vila Belmiro, do Santos, três empresas vão gerenciar a biometria facial.

Em relação aos fornecedores da tecnologia para os estádios, há cinco empresas que controlam o uso em todo o Brasil: Bepass, Imply, Club System, FacePass e Tik+11.

Conforme o monitoramento do O Panótptico, Imply e Bepass lideram os contratos.

A datificação dos torcedores

Os estádios, controlados por essas empresas privadas, deveriam cumprir rigorosamente as normas estabelecidas pela LGPD, assegurando a privacidade e a proteção dos dados pessoais dos frequentadores, mas acabam entrando em uma “zona cinzenta regulatória”.

Quando um estádio associa a compra do ingresso ao registro facial, todos que acessarem o local estão submetidos ao processo de ‘datificação dos torcedores’, que nada mais é do que transformar as nossas ações sociais em dados que podem ser capturados, quantificados e analisados, possibilitando formas de monitoramento e até mesmo de predição do comportamento dos indivíduos.

Essa imposição acontece, inclusive, com crianças e adolescentes, já que também estão sendo cadastradas, como apontado acima.

“A Lei Geral do Esporte não traz nenhuma regulamentação para a implementação da tecnologia de reconhecimento facial. Além disso, há uma grande zona cinzenta em que os torcedores não têm conhecimento sobre qual é a empresa que está captando esse dado dele. Não há um alerta para o torcedor de que o dado é sensível, permanente. É um daqueles alertas: “Li e aceito”, e a gente só aceita. Não é taxativo, não demonstra isso claramente para o torcedor”, explicou Raquel.

O cadastro da biometria facial, em geral, é feito por meio de duas fotografias: uma selfie e uma foto de um documento. Esses dados são enviados apenas uma vez. O registro da face do torcedor é administrado por uma empresa, e nem sempre a empresa que produz os ingressos é a mesma que controla os dados biométricos.

Segundo o relatório, no Maracanã, três empresas distintas trabalham com dados para o acesso do torcedor ao estádio pela biometria facial. A TI3x é responsável pelo controle do acesso; a Imply é a empresa que vende os ingressos; e a Bepass é quem gerencia o reconhecimento facial.

Só aí há uma enorme troca de informações dos torcedores entre diferentes empresas e sem a regulamentação necessária, todos estão expostos à utilização de suas informações para diversos fins.

A Bepass, por exemplo, contratada pelo Palmeiras, Santos, Flamengo, subcontrata a AMAZON AWS SERVICOS BRASIL LTDA como operadora de dados.

Em um relato ao grupo de pesquisa do relatório, um torcedor do Flamengo contou ter seu cartão clonado.

“Eu acho que uma das principais preocupações minhas é realmente com vazamento de dados. Porque, no sócio do Flamengo, eu já tive experiência, de cadastrar um cartão no sócio do Flamengo (cartão de crédito), e ele ser clonado! E aí eu decidi fazer essa experiência criando um cartão virtual. Eu deixei o meu cartão virtual só para pagar o ingresso, né? E mesmo assim ele foi clonado! Eu tenho essa preocupação, não só de como vai ser o gerenciamento desse dado, em quem isso vai chegar”

Racismo e a falta de controle na TRF

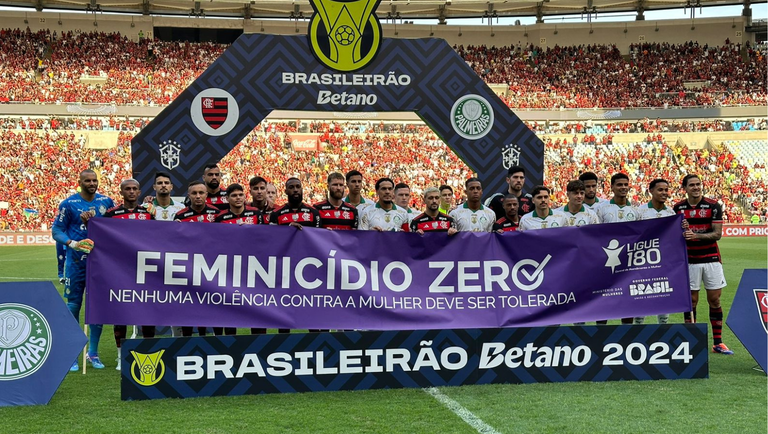

Em 13 de abril de 2024, Confiança e Sergipe disputaram, na arena Batistão, em Aracaju, a final do campeonato sergipano de futebol. Apesar do título do Confiança, o jogo ficou marcado por outro motivo.

João Antônio, torcedor do Confiança, não pôde comemorar porque, no intervalo do jogo, foi retirado do meio da torcida por mais de dois policiais militares do estado. Naquele momento, a única explicação que o torcedor teve foi de que teria sido identificado pelo sistema de reconhecimento facial do estádio como uma pessoa que estava com mandado de prisão em aberto.

Segundo contou João, durante o diálogo, o policial disse que a tecnologia “dificilmente erra”. Neste caso, porém, o sistema estava errado. As imagens do constrangimento e da violência provocados pelo erro circularam nacionalmente, até que o governador decidiu suspender a utilização da tecnologia de controle biométrico no estado.

Parece um delinquente, um foragido, mas esse aí sendo conduzido pela polícia SOU EU.

Sábado na final do campeonato sergipano passei uma uma situação que nunca imaginei que fosse possível e venho com vergonha e indignação compartilhar para que algo aconteça e isso não se repita.+ pic.twitter.com/bDsSZSGM75

— Simplesmente João Antônio (@joantoniotb) April 15, 2024

“Os exemplos que a gente viu no Brasil foram massivamente com pessoas negras. O João Antônio, torcedor do Confiança, é um homem negro. A população negra, principalmente as mulheres negras, sofrem uma série de violências da sociedade. Expô-la a uma taxa de erro tão maior, no momento em que está indo ter um tipo de lazer, é expor pessoas que já sofrem socialmente com diversos tipos de violência a mais uma em um momento que deveria ser de alegria, de felicidade”, apontou Raquel.

Um estudo publicado em 2018 apontou que os algoritmos de reconhecimento facial analisados tendem a ter taxas de erros maiores com mulheres negras (34,7%), enquanto o erro máximo para homens brancos foi de 0,8%.

Em 2019, a pesquisa “Um Rio de câmeras com olhos seletivos: uso do reconhecimento facial pela polícia fluminense”, também produzida pelo O Panóptico, apontou que em um teste feito com a tecnologia de reconhecimento facial no Maracanã, 7 de 11 pessoas detidas pela Polícia Militar do Rio de Janeiro não tinham nenhum mandado de prisão em seu nome.

O que dizem os torcedores?

Os pesquisadores foram ouvir diretamente dos torcedores sobre a utilização da Tecnologia de Reconhecimento Facial nos estádios. O viés econômico, é um dos problemas citados por quem frequenta o estádio.

Emprestar a carteirinha é um hábito comum entre os torcedores brasileiros, especialmente no contexto em que os valores dos ingressos estão cada vez mais altos e o processo de elitização do futebol só aumenta.

Nem todo mundo tem dinheiro para pagar o Avante (sócio torcedor do Palmeiras). Antes a gente emprestava o cartão, e tinha sempre um da gente lá dentro, hoje não pode, e você vê um estádio que a maioria é branco! (sic.) Sem contar que eles acham que todo mundo tem celular na quebrada para fazer o cadastro, às vezes tem celular, mas não tem câmera frontal para fazer a foto – relatou um torcedor do Palmeiras.

Há também a preocupação com as denúncias de violências sofridas por torcedores pelos agentes de segurança no interior dos estádios. Para este assunto, os pesquisadores encontraram uma divergência, conforme o relato de uma torcedora do Goiás.

A TRF poderia ser utilizada como garantia de provas para denúncia de violência sofrida por torcedores, mas este fim não foi alcançado.

“Dia 27 de novembro de 2023, Goiás e Cruzeiro aqui da Serrinha. A gente passou por uma situação de violência policial onde não foi cometido nenhum crime. E aí a gente precisou das imagens para a gente provar, né? O que o clube entregou para a gente foram imagens que não dava para ver nada! A tecnologia ela é nítida, o que fica a falha (sic) é o olhar subjetivo de quem tá ali olhando, né? Eu acho que nem o celular que a gente tinha em 2005 era capaz de gravar a imagem tão ruim! Propositalmente alterada! Então a gente deixa a reflexão de até que ponto, né? Que vai ou não vai ajudar!”

Vale destacar que não foram só os pontos negativos levantados pelos torcedores. Ainda na torcida do Palmeiras, alguns afirmaram que a entrada passou a ser um pouco mais rápida — fato confirmado pelos pesquisadores.

Outro ponto positivo apresentado, principalmente pelas torcedoras, é a possibilidade de identificação mais rápida de um assediador e a possível redução de violência de gênero nos estádios.

E os cambistas?

Preocupação constante dos torcedores, os cambistas também são um motivo para a implementação da biometria facial. O relatório analisou dois jogos: Palmeiras e Corinthians, dia 02 de julho de 2024; Vasco da Gama e Corinthians, dia 10 de julho de 2024.

Em São Januário, primeiro com acesso somente por reconhecimento facial, não foram encontrados cambistas com ingressos disponíveis. Já para o clássico paulista, os pesquisadores informaram que desde 26 de junho havia anúncios de ingressos para a partida.

Ao questionarem um cambista sobre como a venda era realizada, se tinha algum esquema com a polícia ou segurança, ele afirmou: “a gente já tem o esquema”. Em seguida, informou que, era só mandar os dados (nome completo, endereço, CPF e telefone), que ele realizaria um login para inserir os dados faciais.

A conclusão do relatório mostra que, ao menos nos jogos do Palmeiras, a justificativa “cambistas” é completamente descartada. O grupo conseguiu um “esquema” para continuar com as vendas, com a cama extra de exposição do torcedor com a disponibilização da biometria facial.

TRF negada nos Jogos Olímpicos

Nas Olimpíadas de 2024, em Paris, a Tecnologia de Reconhecimento Facial não foi adotada. Isso porque a Comissão Nacional de Informática e Liberdade (CNIL), apresentou justificativas para as autoridades que infringiam as leis de proteção de dados francesa, como:

- O potencial risco de vigilância sem precedentes e a possibilidade de minar o anonimato na esfera pública;

- A identificação exclusivamente realizada por um dado sensível e permanente, como o rosto

- A tecnologia tendenciosa e imperfeita dada a variância da taxa de erro conforme a cor e o sexo das pessoas.